N种attention

时间:2020-06-16 13:12:24

收藏:0

阅读:37

https://www.cnblogs.com/BlueBlueSea/p/13137757.html,是我这篇文章的一个深入和展开吧

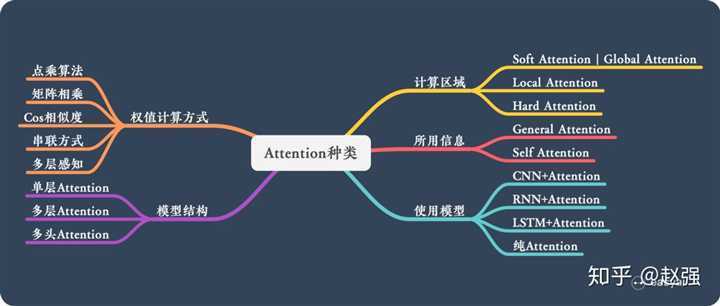

1.总结

转自:https://zhuanlan.zhihu.com/p/91839581

2.CNN/LSTM+ATT

对cnn结合att的过程不太明白。

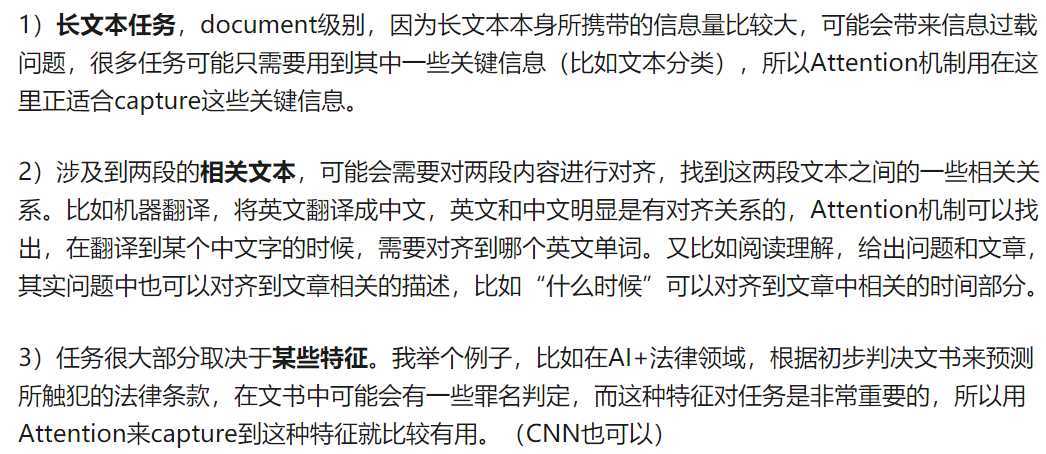

3.适用任务

https://zhuanlan.zhihu.com/p/35739040

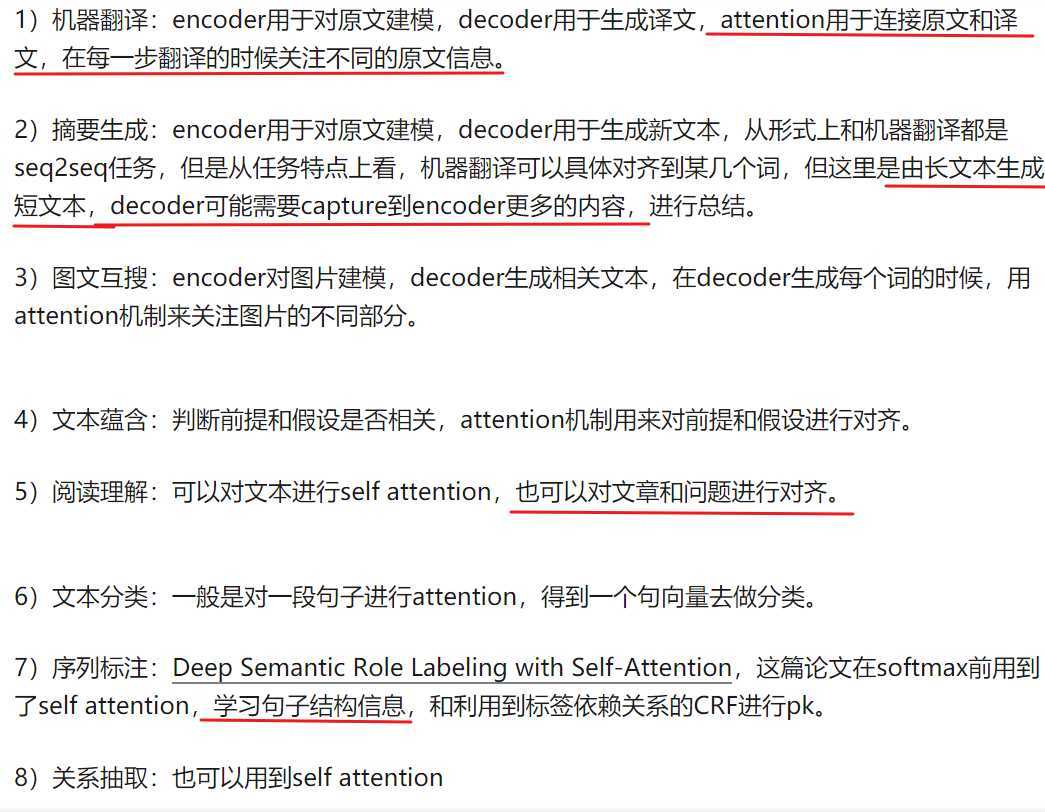

- 机器翻译、摘要生成、图文互搜属于seq2seq任务,需要对两段内容进行对齐,

- 文本蕴含用到前提和假设两段文本,阅读理解也用到了文章和问题两段文本,

- 文本分类、序列标注和关系抽取属于单文本Attention的做法。

原文:https://www.cnblogs.com/BlueBlueSea/p/13140258.html

评论(0)