redis 数据库

时间:2019-07-09 20:11:52

收藏:0

阅读:116

一 简介

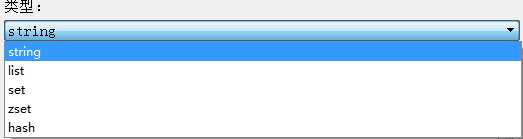

redis是一个key-value存储系统。和Memcached类似,它支持存储的value类型相对更多,包括string(字符串)、list(链表)、set(集合)、zset(sorted set --有序集合)和hash(哈希类型)。这些数据类型都支持push/pop、add/remove及取交集并集和差集及更丰富的操作,而且这些操作都是原子性的。在此基础上,redis支持各种不同方式的排序。与memcached一样,为了保证效率,数据都是缓存在内存中。区别的是redis会周期性的把更新的数据写入磁盘或者把修改操作写入追加的记录文件,并且在此基础上实现了master-slave(主从)同步

1. 使用Redis有哪些好处?

(1) 速度快,因为数据存在内存中,类似于HashMap,HashMap的优势就是查找和操作的时间复杂度都是O(1)

(2) 支持丰富数据类型,支持string,list,set,sorted set,hash

(3) 支持事务,操作都是原子性,所谓的原子性就是对数据的更改要么全部执行,要么全部不执行

(4) 丰富的特性:可用于缓存,消息,按key设置过期时间,过期后将会自动删除

2. redis相比memcached有哪些优势?

(1) memcached所有的值均是简单的字符串,redis作为其替代者,支持更为丰富的数据类型

(2) redis的速度比memcached快很多

(3) redis可以持久化其数据

3. redis常见性能问题和解决方案:

(1) Master最好不要做任何持久化工作,如RDB内存快照和AOF日志文件

(2) 如果数据比较重要,某个Slave开启AOF备份数据,策略设置为每秒同步一次

(3) 为了主从复制的速度和连接的稳定性,Master和Slave最好在同一个局域网内

(4) 尽量避免在压力很大的主库上增加从库

(5) 主从复制不要用图状结构,用单向链表结构更为稳定,即:Master <- Slave1 <- Slave2 <- Slave3...

这样的结构方便解决单点故障问题,实现Slave对Master的替换。如果Master挂了,可以立刻启用Slave1做Master,其他不变。

4. MySQL里有2000w数据,redis中只存20w的数据,如何保证redis中的数据都是热点数据

相关知识:redis 内存数据集大小上升到一定大小的时候,就会施行数据淘汰策略。redis 提供 6种数据淘汰策略:

voltile-lru:从已设置过期时间的数据集(server.db[i].expires)中挑选最近最少使用的数据淘汰

volatile-ttl:从已设置过期时间的数据集(server.db[i].expires)中挑选将要过期的数据淘汰

volatile-random:从已设置过期时间的数据集(server.db[i].expires)中任意选择数据淘汰

allkeys-lru:从数据集(server.db[i].dict)中挑选最近最少使用的数据淘汰

allkeys-random:从数据集(server.db[i].dict)中任意选择数据淘汰

no-enviction(驱逐):禁止驱逐数据

5. Memcache与Redis的区别都有哪些?

1)、存储方式

Memecache把数据全部存在内存之中,断电后会挂掉,数据不能超过内存大小。

Redis有部份存在硬盘上,这样能保证数据的持久性。

2)、数据支持类型

Memcache对数据类型支持相对简单。

Redis有复杂的数据类型。

3),value大小

redis最大可以达到1GB,而memcache只有1MB

6. Redis 常见的性能问题都有哪些?如何解决?

1).Master写内存快照,save命令调度rdbSave函数,会阻塞主线程的工作,当快照比较大时对性能影响是非常大的,会间断性暂停服务,所以Master最好不要写内存快照。

2).Master AOF持久化,如果不重写AOF文件,这个持久化方式对性能的影响是最小的,但是AOF文件会不断增大,AOF文件过大会影响Master重启的恢复速度。Master最好不要做任何持久化工作,包括内存快照和AOF日志文件,特别是不要启用内存快照做持久化,如果数据比较关键,某个Slave开启AOF备份数据,策略为每秒同步一次。

3).Master调用BGREWRITEAOF重写AOF文件,AOF在重写的时候会占大量的CPU和内存资源,导致服务load过高,出现短暂服务暂停现象。

4). Redis主从复制的性能问题,为了主从复制的速度和连接的稳定性,Slave和Master最好在同一个局域网内

7, redis 最适合的场景

Redis最适合所有数据in-momory的场景,虽然Redis也提供持久化功能,但实际更多的是一个disk-backed的功能,跟传统意义上的持久化有比较大的差别,那么可能大家就会有疑问,似乎Redis更像一个加强版的Memcached,那么何时使用Memcached,何时使用Redis呢?

如果简单地比较Redis与Memcached的区别,大多数都会得到以下观点:

1 、Redis不仅仅支持简单的k/v类型的数据,同时还提供list,set,zset,hash等数据结构的存储。

2 、Redis支持数据的备份,即master-slave模式的数据备份。

3 、Redis支持数据的持久化,可以将内存中的数据保持在磁盘中,重启的时候可以再次加载进行使用。

(1)、会话缓存(Session Cache)

最常用的一种使用Redis的情景是会话缓存(session cache)。用Redis缓存会话比其他存储(如Memcached)的优势在于:Redis提供持久化。当维护一个不是严格要求一致性的缓存时,如果用户的购物车信息全部丢失,大部分人都会不高兴的,现在,他们还会这样吗?

幸运的是,随着 Redis 这些年的改进,很容易找到怎么恰当的使用Redis来缓存会话的文档。甚至广为人知的商业平台Magento也提供Redis的插件。

(2)、全页缓存(FPC)

除基本的会话token之外,Redis还提供很简便的FPC平台。回到一致性问题,即使重启了Redis实例,因为有磁盘的持久化,用户也不会看到页面加载速度的下降,这是一个极大改进,类似PHP本地FPC。

再次以Magento为例,Magento提供一个插件来使用Redis作为全页缓存后端。

此外,对WordPress的用户来说,Pantheon有一个非常好的插件 wp-redis,这个插件能帮助你以最快速度加载你曾浏览过的页面。

(3)、队列

Reids在内存存储引擎领域的一大优点是提供 list 和 set 操作,这使得Redis能作为一个很好的消息队列平台来使用。Redis作为队列使用的操作,就类似于本地程序语言(如Python)对 list 的 push/pop 操作。

如果你快速的在Google中搜索“Redis queues”,你马上就能找到大量的开源项目,这些项目的目的就是利用Redis创建非常好的后端工具,以满足各种队列需求。例如,Celery有一个后台就是使用Redis作为broker,你可以从这里去查看。

(4),排行榜/计数器

Redis在内存中对数字进行递增或递减的操作实现的非常好。集合(Set)和有序集合(Sorted Set)也使得我们在执行这些操作的时候变的非常简单,Redis只是正好提供了这两种数据结构。所以,我们要从排序集合中获取到排名最靠前的10个用户–我们称之为“user_scores”,我们只需要像下面一样执行即可:

当然,这是假定你是根据你用户的分数做递增的排序。如果你想返回用户及用户的分数,你需要这样执行:

ZRANGE user_scores 0 10 WITHSCORES

Agora Games就是一个很好的例子,用Ruby实现的,它的排行榜就是使用Redis来存储数据的,你可以在这里看到。

(5)、发布/订阅

最后(但肯定不是最不重要的)是Redis的发布/订阅功能。发布/订阅的使用场景确实非常多。我已看见人们在社交网络连接中使用,还可作为基于发布/订阅的脚本触发器,甚至用Redis的发布/订阅功能来建立聊天系统!(不,这是真的,你可以去核实)。

Redis提供的所有特性中,我感觉这个是喜欢的人最少的一个,虽然它为用户提供如果此多功能。

支持的数据类型(5大数据类型)

redis={

k1:‘123‘, 字符串

k2:[1,2,3,4], 列表/数组

k3:{1,2,3,4} 集合

k4:{name:lqz,age:12} 字典/哈希表

k5:{(‘lqz‘,18),(‘egon‘,33)} 有序集合

}

特点:

可以持久化 单线程,单进程

安装和使用:

安装模块:pip3 intall redis

from redis import Redis from redis import ConnectionPool

Redis实例化产生对象,就是拿到一个redis的连接

conn=Redis()

操作redis(value部分都是以byte格式存储)

ret=conn.get(‘name‘) print(ret)

redis连接池

pool需要做成单例

pool=ConnectionPool(host=‘127.0.0.1‘,port=6379,max_connections=100) conn=Redis(connection_pool=pool) print(conn.get(‘name‘))

添加数据

conn.set(‘age‘,20)

获取数据

ret=conn.get(‘age‘) print(ret)

设置数据,多少秒后删除(k,s,v)

conn.setex(‘xxx‘,5, ‘ppp‘)

批量设置(传字典)

mset(已存在键值会覆盖)

conn.mset({‘name‘:‘wy‘,‘age‘:20,‘height‘:180})

批量获取

mget

print(conn.mget([‘name‘,‘height‘]))

从某个位置开始,有只则覆盖,无值则追加

conn.setrange(‘name‘,1,‘xx‘)

incr 自增(文章阅读数,网站访问量的统计)

conn.incr(‘age‘,amount=2)

decr 自减

conn.decr(name=‘age‘,amount=2)

append 无则新建,有则追加

conn.append(‘name‘,‘hhhhh‘)

hash操作

hset 无则添加,有则修改

conn.hset(‘hash1‘,‘k1‘,‘value1‘)

批量设置

conn.hmset(‘hash2‘,{‘name‘:‘qlz‘,‘age‘:18})

取值

print(conn.hget(‘hash1‘,‘k1‘))

批量取值

print(conn.hmget(‘hash2‘,[‘name‘,‘age‘])) print(conn.hmget(‘hash2‘,‘name‘,‘age‘))

取全部

print(conn.hgetall(‘hash2‘)[b‘name‘])

字段条数

print(conn.hlen(‘hash1‘))

删除

conn.hdel(‘hash1‘,‘k1‘)

自增

conn.hincrby(‘hash1‘,‘age‘,amount=1)

重点: hscan 、hscan_iter

for i in range(10000): conn.hset(‘hash3‘,‘key%s‘%i,‘value%s‘%i)

从0开始取一百位

print(conn.hscan(‘hash3‘,0,count=100))

hscan_iter:获取字典所有数据的时候,推荐用这个,而不用 hgetall

print(conn.hscan_iter(‘hash3‘)) for i in conn.hgetall(‘hash3‘): print(i) for i in conn.hscan_iter(‘hash3‘,100): print(i)

redis之列表操作

加在第一个位置

conn.lpush(‘list1‘,‘13‘)

加在最后一个位置

conn.rpush(‘list1‘,‘11‘)

表的数据条数

print(conn.llen(‘list1‘))

找到的第一个12的前面插入999

conn.linsert(‘list1‘,‘BEFORE‘,12,999)

找到的第一个12的后面插入666

conn.linsert(‘list1‘,‘AFTER‘,12,666)

从0开始,第五位插入

conn.lset(‘list1‘,‘4‘,123)

删除第几个值为多少的元素

conn.lrem(‘list1‘,1,12)

根据索引取值

print(conn.lindex(‘list1‘,11))

1,3 前后都是闭区间

print(conn.lrange(‘list1‘,1,3))

blpop 重点掌握

删除并返回删除的值

print(conn.lpop(‘list1‘))

没有值可以阻塞住,可以实现分布式

print(conn.blpop(‘list1‘))

# 没有值时不手动结束,会一直在这等到有值再运行

获取列表中所有值:

for i in range(1000): conn.lpush(‘list1‘,i) print(conn.lrange(‘list1‘,0,conn.llen(‘list1‘))) def scan_list(name,count=10): index=0 while True: data_list=conn.lrange(name,index,count+index-1) if not data_list: return index+=count for item in data_list: yield item print(conn.lrange(‘list1‘,0,100)) print(‘------‘) for item in scan_list(‘list1‘,5): print(‘---‘) print(item)

删除age

conn.delete(‘age‘)

判断k1是否存在,返回1 or 0

print(conn.exists(‘k1‘))

单个字符匹配

print(conn.keys(‘k?‘))

模糊匹配(h开头)

print(conn.keys(‘h*‘))

重命名

conn.rename(‘hash1‘,‘xxx‘) print(conn.type(‘list1‘))

在django中使用redis

方式一

新建一个py文件,在视图类中导入

utils>redis_pool:

import redis Pool=redis.ConnectionPool(host=‘127.0.0.1‘,port=6379,max_connections=100)

views:

from django.shortcuts import render,HttpResponse # Create your views here. from redis import Redis from utils.redis_pool import Pool conn=Redis(connection_pool=Pool) def index(request): ret=conn.get(‘name‘) print(ret) return HttpResponse(‘ok‘)

方式二:

在setting中配置

安装django-redis模块

pip3 install django-redis

setting里配置:

# redis配置 CACHES = { "default": { "BACKEND": "django_redis.cache.RedisCache", "LOCATION": "redis://127.0.0.1:6379", "OPTIONS": { "CLIENT_CLASS": "django_redis.client.DefaultClient", "CONNECTION_POOL_KWARGS": {"max_connections": 100} # "PASSWORD": "123", } } }

views:

from django_redis import get_redis_connection conn = get_redis_connection(‘default‘) print(conn.hgetall(‘xxx‘))

管道

redis-py默认在执行每次请求都会创建(连接池申请连接)和断开(归还连接池)一次连接操作,如果想要在一次请求中指定多个命令,则可以使用pipline实现一次请求指定多个命令,并且默认情况下一次pipline 是原子性操作。

import redis pool = redis.ConnectionPool(host=‘10.211.55.4‘, port=6379) r = redis.Redis(connection_pool=pool) # pipe = r.pipeline(transaction=False) pipe = r.pipeline(transaction=True) pipe.multi() pipe.set(‘name‘, ‘alex‘) pipe.set(‘role‘, ‘sb‘) pipe.execute()

原文:https://www.cnblogs.com/tuzaizi/p/11159668.html

评论(0)